大數據 解鎖大問題的鑰匙與數據處理、存儲的支撐服務

在當今數字化時代,我們面臨的問題日益復雜和龐大,從城市交通擁堵、流行病預測到氣候變化分析、精準醫療,無不涉及海量、多源、高速生成的數據。傳統的數據處理方法在這些“大問題”面前顯得力不從心。而大數據技術,正憑借其強大的數據處理和存儲支持服務,成為解決這些大問題的關鍵鑰匙。

一、大數據如何解決大問題:從洞察到決策

大數據解決大問題的核心邏輯在于:通過收集和分析遠超傳統數據庫處理能力的龐大數據集,揭示隱藏的模式、未知的相關性和趨勢,從而將數據轉化為深刻的洞察和可執行的智能。

- 全面感知與精準預測:大數據使我們能夠近乎實時地收集和分析來自物聯網設備、社交媒體、交易記錄等多維度的信息。例如,在公共衛生領域,通過整合搜索關鍵詞、移動定位、醫療報告等數據,可以更早、更精準地預測并追蹤疫情爆發點,為防控決策贏得寶貴時間。

- 個性化與優化:在商業領域,大數據分析客戶行為、偏好和歷史交互,能夠實現產品推薦、動態定價和個性化營銷,極大提升用戶體驗和商業效率。在工業領域,通過對生產線上傳感器數據的實時分析,可以預測設備故障,優化生產流程,減少停機損失。

- 復雜系統模擬與決策支持:對于如智慧城市、全球供應鏈、金融風險等復雜系統,大數據可以構建高精度的數字孿生模型。通過模擬不同策略下的系統反應,決策者可以在虛擬環境中“試錯”,找到最優解決方案,從而做出更科學、更前瞻的決策。

二、數據處理與存儲:大數據的堅實基座

大數據價值的釋放,離不開底層強大的數據處理和存儲支持服務作為技術基座。這些服務共同構成了大數據解決方案的“引擎”和“倉庫”。

1. 數據處理支持服務:從原始數據到可用信息

數據處理是將原始、雜亂的數據轉化為結構化、高質量信息的過程,主要包括:

- 數據采集與集成:使用如Apache Flume、Kafka等工具,從各種來源(日志、傳感器、數據庫)實時或批量地收集數據,并進行清洗、去重、格式化,解決數據孤島問題。

- 數據存儲與管理:這不僅是簡單的存放,更是為高效分析做準備。數據湖(Data Lake)允許存儲原始格式的海量數據,而數據倉庫(Data Warehouse)則存儲經過清洗和建模的結構化數據,服務于不同的分析場景。

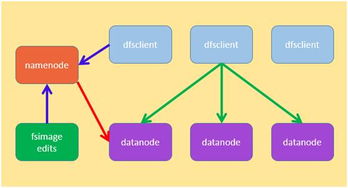

- 數據計算與分析:這是核心環節。批處理框架(如Hadoop MapReduce, Spark)用于處理歷史數據,進行深度挖掘;流處理框架(如Spark Streaming, Flink)則對實時數據流進行即時分析,滿足低延遲需求。

- 數據治理與安全:確保數據在整個生命周期中的質量、一致性、合規性和安全性,包括元數據管理、數據血緣追蹤、訪問控制和隱私保護(如差分隱私、聯邦學習)。

2. 數據存儲支持服務:彈性、可靠與高性能的保障

海量數據的存儲需求催生了革命性的存儲解決方案:

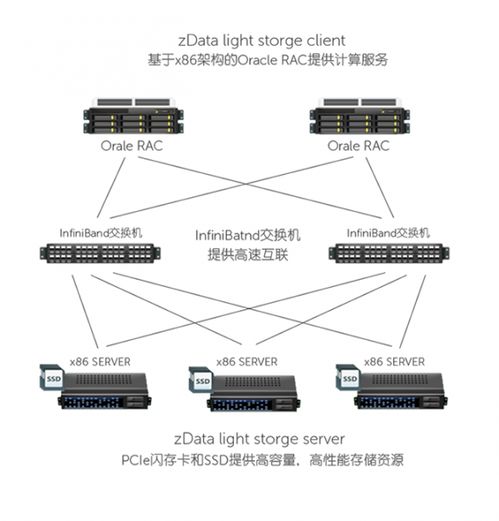

- 分布式文件系統:如HDFS(Hadoop Distributed File System),將大文件分割成塊,分布式存儲在廉價的商用服務器集群上,提供了高吞吐量的數據訪問能力和高容錯性。

- NoSQL數據庫:針對不同數據類型和訪問模式,出現了鍵值存儲(如Redis)、文檔數據庫(如MongoDB)、列族數據庫(如HBase)和圖數據庫(如Neo4j),它們放棄了嚴格的關系模型,換來了極致的可擴展性和靈活性。

- 云存儲服務:以AWS S3、Azure Blob Storage、阿里云OSS為代表的云對象存儲,提供了近乎無限的容量、極高的持久性和按需付費的模式,使得企業無需自建數據中心即可安全、經濟地存儲海量數據。

- 新興存儲技術:如計算存儲一體化、持久內存(PMEM)等,正在進一步打破存儲與計算之間的瓶頸,提升數據處理效率。

###

大數據并非簡單的“數據大”,而是一套以數據為中心,集先進的數據處理、存儲、分析技術于一體的系統性解決方案。它通過將強大的數據處理引擎與彈性可擴展的存儲架構相結合,賦予了我們洞察復雜現象、預測未來趨勢、優化現實世界的能力。面對日益增長的社會經濟挑戰,持續發展和完善的數據處理與存儲支持服務,將是驅動大數據持續挖掘價值、真正解決“大問題”的不竭動力。企業和社會組織只有夯實這一技術基座,才能在未來數據驅動的競爭中贏得先機。

最新產品

從德國首戰失利到企業數據加速解決方案 數據處理與存儲支持服務的未來機遇

锘海nh dsap系列 數據存儲與處理的完整解決方案

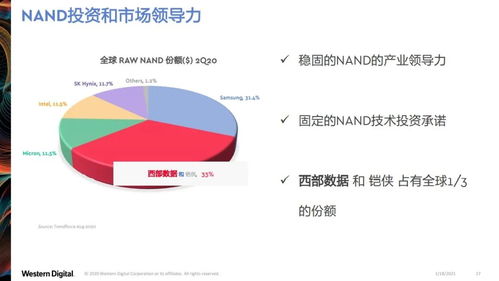

西部數據 數據驅動萬物時代的存儲分層之道

數字化時代的基石 數據存儲表示法及其與處理和存儲支持服務的關系

分布式數據庫存儲設計的革新 構建高效、可靠的數據處理與存儲支持服務體系

云操作系統研發與應用國家地方聯合工程研究中心 數據處理與存儲支持服務的技術架構與應用價值

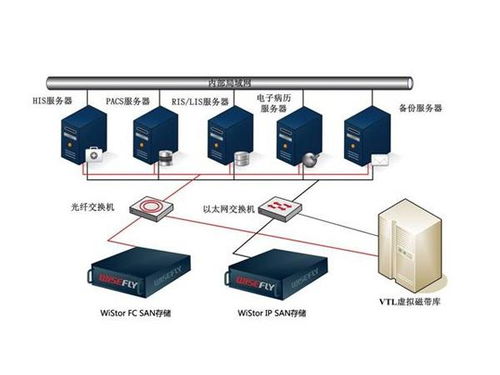

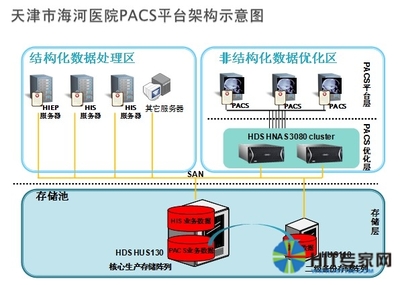

天津海河醫院 突破影像調閱速度瓶頸,以數據處理與存儲支持服務賦能智慧醫療

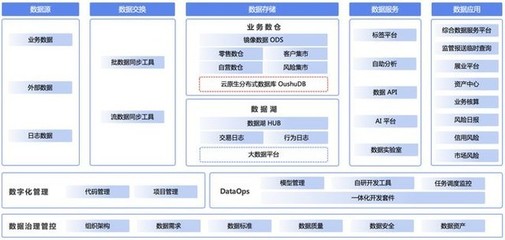

OushuDB × 東方證券 數據倉庫信創國產化最佳實踐與全棧服務支持

XSKY推出OCPF開放內容處理框架,首期聚焦圖片處理能力,賦能數據處理與存儲服務

大數據 解鎖大問題的鑰匙與數據處理、存儲的支撐服務